“每个人都是实验者,而实验者不应妄下论断。许多问题的答案,只能边走边找。”

文 /巴九灵(微信公众号:吴晓波频道)

短短三天内,OpenAI创始人奥特曼的家遭遇了两次袭击。

4月12日凌晨,两个二十岁出头的年轻人,将一辆本田轿车开到奥特曼家门口。副驾驶座上的人将手伸出车窗外,向房屋开了一枪。

就在三天前,这栋位于旧金山、价值2700万美元的豪宅被人投掷燃烧弹起火。

图源:NBC News

向奥特曼家投掷燃烧弹的也是一名20岁男子,他把这场袭击视为“人类对抗AI的圣战”。他曾在社交媒体上激愤地指责OpenAI等科技巨头是“人类文明的叛徒”,称“AI军备竞赛最终会导致人类灭绝,现在不反抗,未来就没有机会了”。

越来越多人觉得他并非危言耸听。今年2月,研究机构Citrini在一篇《2028年全球智能危机》报告里写道,AI替代人类工作,将导致2027年底美国的失业率从现在的4.3%上升到10.2%。

对“AI末世论”的恐惧,开始甚嚣尘上。

一

裁员潮来了

恐慌主要来自两个词:裁员和“蒸馏”。

根据日经亚洲的统计数据,今年以来全球科技行业裁员人数已经达到8万人左右,创下了近三年单季度高峰;其中近4万个职位的裁撤,被企业归因于AI与工作流自动化带来的人力需求缩减。

技术革命往往伴随阵痛,但这是史上最猝不及防的一次。从瓦特改良蒸汽机到英国爆发工人打砸机器的卢德运动,经历了60年时间;而从ChatGPT为大众所知,到今天科技巨头“史上最大规模裁员”,仅仅过了3年。

裁员理由,除了众所周知的“活儿都可以让AI干了”,如今还多了一项“优秀的离职员工可以被蒸馏技能”。

蒸馏是个AI行业术语,指把更优秀的模型输出的内容,喂给水平更差的模型,让后者模仿和学习前者的行为和判断逻辑。

现在,它多了一层意思:把人类输出的内容喂给AI,让它模仿人类。

最近GitHub开发者社区里,出现了一个叫“同事.skill”的热门项目,本质就是指示AI去蒸馏同事。大家构想,AI充分学习了人类的工作资料以后,就能“把离职的同事炼化成智能体,让他/她永远留在公司。”

社交媒体充斥着这样的故事和亲身经历,“AI末世论”有了散播恐慌的温床。

从劳动分工来看,“AI末世”中第一个被迫出局的,是基层白领。

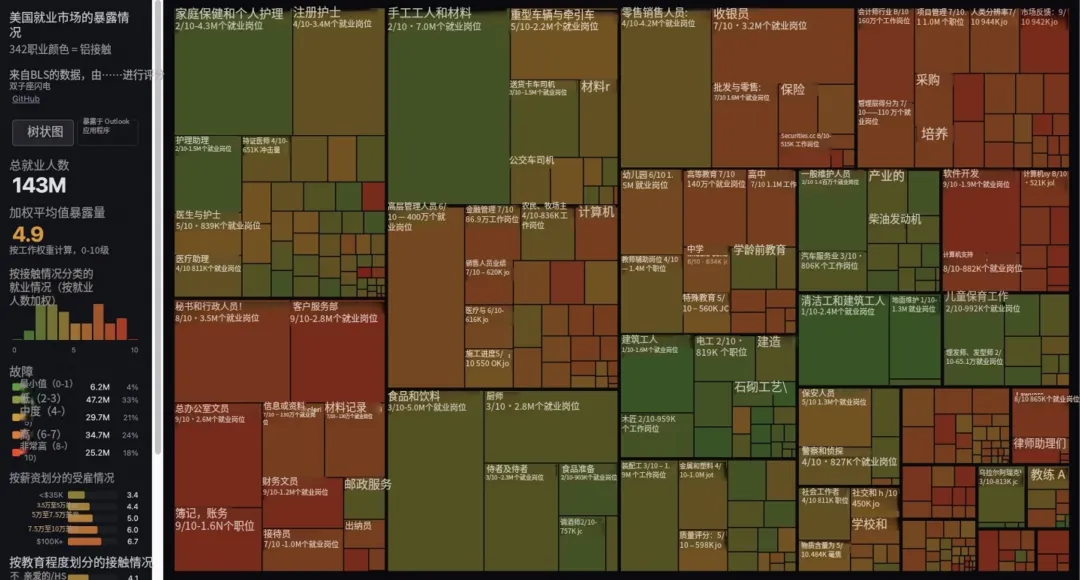

OpenAI 联合创始人Andrej Karpathy对美国342个职业做了一次AI替代风险暴露度评分,发现有41%的劳工落在高风险区,其中财务、文员、信息服务等是重灾区。

第二批淘汰的,是中层管理者。

4月初,美国金融科技公司Block的CEO杰克·多西发表了一篇观点十分激进的文章,认为AI时代的终极组织形态是科层制的彻底消失。公司的核心是AI超级大脑,能分析数据、感知和思考客户需求,然后直接分配任务,不再需要庞大的中层群体来上传下达。

他认为,过去公司的效率瓶颈是信息在人类层级中流动的速度太慢。如果拆除这些层级,让信息在AI系统中光速流动,企业就会快如闪电。

更长远来看,第三批淘汰的是下一代年轻人。

“老带新”是最普遍的职场培养机制,但如果AI比年轻的实习生更好用、成长更快,那么企业就会用训练AI代替培养新人。

Anthropic的研究就显示,自2022年底ChatGPT上线以来,各年龄段、各工种入职率并未出现明显波动,或者说,尚未产生大面积替代效应。但是,22岁至25岁年轻人进入高暴露职业(即理论上AI可替代率较高的工种)的入职率,2024年至今下滑了约14%。

二

不能全甩锅给AI

然而,这并非“裁员潮”的全貌。

首先,科技行业大规模裁员不能完全归罪于AI。

AI革命爆发之前,科技界就已经开始裁员,当下这一轮,很大程度上是对疫情期间过度扩张的市场化纠错。

硅谷的裁员潮其实已经持续了三年。如果把2020—2022年期间的雇员峰值和2019年底数据相比,亚马逊人力规模一度扩张了103%,特斯拉扩张了107%,Meta扩张了94%。

以Meta为例。2019年底,公司员工总数是44942人,到2022年底增加到86400人,几乎翻了一倍。同时激进扩张的还有公司的业务,2019年,Meta雄心勃勃地推出“元宇宙”计划,5年后这个部门累计亏损了465亿美元。

2023年一季度,Meta大举裁员1.1万人,并对外表示,这年将以“效率”为主题。

从这个角度上,知名海外研究机构Gartner的分析师如此评价这场裁员潮:“最近大多数的人力削减,更多是受整体经济环境影响,而不是单纯因为自动化。AI驱动的裁员虽然吸引了大量眼球,但现实要复杂得多。”

其次,AI并不一定比人类更高效。

这由大模型的底层逻辑决定:按照既定的规则,从海量文本中筛选和拼接语言,本质是一种概率逻辑。它的正确率能够无限接近于100%,但无法真正达到100%。

而且,人类在一个岗位上经验越丰富,准确性和效率会越高,这是由鲁棒性知识结构决定的,所谓“越老越吃香”;而AI执行任务是一次性的,上下文越长,理解成本就越高,也越容易出错。

而当出现差错时,它无法应对风险和不确定性,更无法承担责任。

AI还会生成大量看似精美实则空洞的“工作垃圾”,需要人工审查和校正。哈佛商业评论的一篇文章计算,AI在工作中生产“工作垃圾”的概率达到41%,员工每处理一次这些“垃圾”平均要花费近2小时,产生186美元的隐形成本。

以此计算,一家一万人的公司,每年会因此造成超900万美元的损失,还会导致同事之间的关系恶化。

因此,人类依然必须留在岗上,只是角色可能从执行转向监督和协作。

企业们意识到这一点后,只好把辞退的人再招回来。Gartner预测,到2027年,一半因AI裁员的公司会重新招聘同类岗位。

再者,AI不是免费的,甚至不比人工便宜。

去年夏天,麻省理工在一份报告中指出,95%的企业AI投资实际上未能产生经济效益,并被困在“高投入、零回报”的困境中。

搭建AI基础设施需要大量资金投入。举例来说,如果要自建AI团队,企业需要采购GPU、服务器、传感终端、数采设备、数据及数据处理服务等,再组建一个人均年薪50—100万、3—5人的核心工程师团队,成本轻易上千万。

大部分企业选择部署成熟的开源模型,但同样需要部署费用和持续的Token开支。

有媒体报道,一家SaaS公司给全员配置了龙虾补贴,普通员工每日消耗150元Token,技术团队高达1000元。此外,OpenClaw有“心跳机制”,即便不工作,每天也会自动消耗约145元的 Token,折算下来月均损耗超过5000元。

三

人类,再出发

技术不会因为争论和质疑停止狂奔。

如今我们耳中充斥着二元对立的声音:一头是“未来的世界就是会用AI的人替代不会用AI的人”;另一头是末世论,人类将被自己创造的工具导向末路。

站在不同的立场,会产生不同的声音。但过于肯定的结论,往往牵扯着自身的站位。

AI是否会代替人,不是一个非黑即白的二元对立问题。变革之中,每个人都是实验者,而实验者不应妄下论断。许多问题的答案,只能边走边找。

据微软的统计,到2025年底,全球AI普及率达到了16.3%,较半年前提升了1.2%,已经超过了2000年互联网普及率的增长速度。

今天,世界上每6个人就有一个人在用AI,这也意味着过去那些科幻片般的预言和恐吓,将真正迎来被检验、被校准的机会。在几十亿人的用脚投票中,人类将吵吵闹闹、充满波折地穿过一场新的技术革命浪潮。

一周前,OpenAI发布了一份长达13页的政策白皮书,开篇定调,人类正在进入超级智能时代,现有的制度和安全网不够用了。

这篇报告中作出三大呼吁:

◎ 其一,向社会发放“效率红利”,让所有人共享技术带来的繁荣。包括设立公共财富基金、减少工作日、完善社会保障机制等。

◎ 其二,降低安全风险,持续追踪AI对就业、工资、行业结构的影响,动态量化监控。

◎ 其三,建立技术普惠机制,消解AI导致的数字鸿沟。

虽然许多想法显得天马行空,但确乎指向了当下的诸多矛盾。

中国同样在行动。AI训练师、数据治理等新职业被纳入人社部职业认定,去年下半年以来,各地积极推行OPC(一人公司)政策,扶持、补贴灵活就业群体借AI创业。今年两会,多名代表提出,将“AI就业影响评估”纳入政策考量。

吴老师说,归根到底,人与AI的区别有三条:提出问题,提供见解,体现趣味。人要保持灵魂,也无非如此。

与你共勉。

0

推荐

京公网安备 11010502034662号

京公网安备 11010502034662号